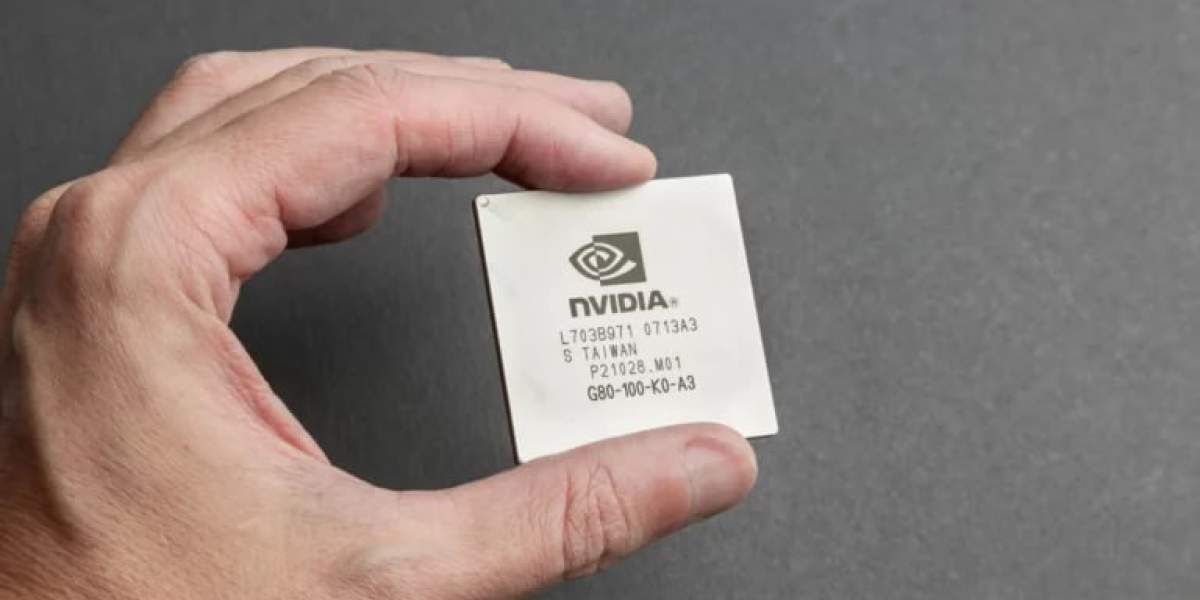

اما برای کاربردهایی که نیاز به پردازش محلی دادهها دارند و نمیتوانند هزینه ۷۰,۰۰۰ دلاری جدیدترین تراشههای بلکول انویدیا را بپردازند، گزینههای مختلفی از تسریعکنندههای هوش مصنوعی کوچکتر در دسترس است که مدل جدیدی برای پیادهسازی هوش مصنوعی ارائه میدهند.

مفهوم محاسبات لبه از سال ۲۰۱۴ توجه زیادی را به خود جلب کرده است؛ در ان زمان این اصطلاح برای شناختن تمایز بین فرآیندهای رایانش محلی از فرآیندهای مبتنی بر رایانش ابری به کار گرفته شد.

هوش مصنوعی لبه به انواع کاربردهای یادگیری ماشینی اشاره دارد که بهصورت محلی و بر روی یک دستگاه خاص مصرفکننده معمولی یا صنعتی انجام میشود.

در حوزه مصرفکننده، هوش مصنوعی لبه به تغییر اولویتها در طراحی الکترونیک منجر شده و تولیدکنندگان رایانههای شخصی و گوشیهای هوشمند را به سمت سختافزارهای جدیدتر و توانمندتر هدایت کرده است که میتوانند عملیات بیشتری را در هر ثانیه انجام دهند.

همچنین، تراشههای هوش مصنوعی لبه برای نیازهای خاص صنایع مانند تولید و خودروسازی طراحی شدهاند.

تولیدکنندگان بزرگ تراشه با گسترش سریع هوش مصنوعی، به نقاط قوت موجود خود تکیه کردهاند.

به عنوان مثال، اینتل بر روی تسریعکنندههای هوش مصنوعی میانوزن تمرکز کرده است که هنوز به منبع تغذیه ثابت نیاز دارند، در حالی که تراشههای کوچکتر از اپل، مدیا تک و کوالکام میتوانند بهطور مؤثری با اتصال به باتری کار کنند.

علاوه بر شرکتهای بزرگ، بازیگران بیشتری نیز در این عرصه فعال شدهاند.

شرکتهایی مانند هایلو و آنتدِر ایآی با تمرکز بر اجرای مدلهای بینایی کامپیوتری، تکنولوژی کلیدی در دوربینهای هوشمند، روباتهای صنعتی و خودروهای خودران، به موفقیتهایی دست یافتهاند.

همچنین، واحد پردازش زبان گرُک به طور خاص برای اجرای مدلهای زبانی طراحی شده و این استارتاپ را به یک رقیب جدی در بازار گوشیهای هوشمند تبدیل کرده است.

در حالی که تولیدکنندگان تراشه بهطور روز افزون بر روی ساخت سختافزارهای مناسب برای بارهای کاری هوش مصنوعی تمرکز کردهاند، توسعهدهندگان نیز مشغول ایجاد مدلهای کوچکتری هستند که میتوانند در دستگاههای لبه پیادهسازی شوند.

به لطف پیشرفتها در قابلیتهای مدلهای کوچک، بسیاری از اپلیکیشنهایی که قبلاً نیاز به سختافزارهای سنگین و اتصال به رایانش ابری داشتند، اکنون میتوانند بهصورت محلی اجرا شوند.

زمانی که متا در سپتامبر جدیدترین مدلهای کوچک زبانی خود را معرفی کرد، تأکید کرد که این مدلها «از روز اول برای سختافزار کوالکام و مدیا تک فعال شدهاند» و بهطور خاص برای پردازندههای آرم بهینهسازی شدهاند که در اکثر دستگاههای موبایل امروزی استفاده میشود.

م/110*